VarInSightAI: KαLOS-Toolkit zur Analyse der Datensatzqualität veröffentlicht.

Der Quellcode für unsere kommende CVPR 2026 Publikation "KαLOS finds Consensus: A Meta-Algorithm for Evaluating Inter-Annotator Agreement in Complex Vision Tasks" steht ab sofort zur Verfügung.

Im Rahmen des VarInSightAI-Projekts bietet dieses Toolkit einen standardisierten Rahmen zur Quantifizierung der Annotationskonsistenz und zur Identifizierung von Annotationsvariationen in komplexen Datensätzen. Das Paper wird im Juni 2026 auf der IEEE/CVF Computer Vision and Pattern Recognition Conference (CVPR) in Denver vorgestellt.

Beschreibung

Visuelle Inspektionen spielen eine zentrale Rolle bei der Bauwerksprüfung, insbesondere bei der Analyse von Schäden an kritischen Infrastrukturen. Annotationsvariationen – Abweichungen, Unsicherheiten und teilweise auch Fehler in den Annotationen – stellen jedoch eine große Herausforderung für das maschinelle Lernen dar, da sie die Modellleistung erheblich beeinträchtigen. Dieses Problem ist nicht auf die Bauwerksprüfung beschränkt, sondern betrifft auch zahlreiche andere Anwendungsbereiche, in denen visuelle Daten verarbeitet werden.

Ziel und Vorgehensweise

Das Projekt befasst sich mit verschiedenen Aspekten im Umgang mit Annotationsvariationen (AV):

- Identifikation, Quantifizierung, Auswirkungsanalyse und Korrektur von AV

- Entwicklung neuer Methoden zur Bewältigung von AV während des Trainings von Modellen

- Erstellung praxisnaher Evaluationsmetriken, die die Auswirkungen von AV berücksichtigen

Zusätzlich wird ein Schadenserkennungsdatensatz mit realen AV kuratiert, um die Forschung voranzutreiben und eine Grundlage für zukünftige Arbeiten zu schaffen.

Software

Die im Projekt entwickelten Erkenntnisse und Werkzeuge werden als frei verfügbare Software veröffentlicht. Bereits jetzt unterstützt das FiftyOne-Plugin Multi-Annotator Toolkit die Identifikation, Quantifizierung und Auswirkungsanalyse von AV.

Förderung

Das Projekt wird von der Deutschen Forschungsgemeinschaft (DFG) mit 381T € gefördert.

Projektlaufzeit: 05/2025 - 04/2028

Projektbezogene Publikationen

- C. Benz und V. Rodehorst: CrackStructures and CrackEnsembles - The Power of Multi- View for 2.5D Crack Detection, IEEE/CVF Winter Conference on Applications of Computer Vision (WACV), Tucson, Arizona, 2025.

- D. Tschirschwitz und V. Rodehorst: Label Convergence - Defining an Upper Performance Bound in Object Recognition through Contradictory Annotations, IEEE/CVF Winter Conference on Applications of Computer Vision (WACV), Tucson, Arizona, 2025.

- C. Benz und V. Rodehorst: ENSTRECT - A Stage-based Approach to 2.5D Structural Damage Detection, European Conference on Computer Vision (ECCV) 2. Workshop on Vision-based InduStrial InspectiON (VISION), Mailand, Italien, 2024.

- C. Benz und V. Rodehorst. „MVCrackViT: Robust Multi-View Crack Detection for Point Cloud Segmentation using View Attention“. In: Proc. IEEE Int. Conf. on Image Processing (ICIP), 2024.

- C. Benz und V. Rodehorst. „OmniCrack30k: A Benchmark for Crack Segmentation and the Reasonable Effectiveness of Transfer Learning“. In: Proc. IEEE/CVF Conf. on Computer Vision and Pattern Recognition (CVPR) Workshops, 2024.

- J. Flotzinger, P. J. Rösch, C. Benz, M. Ahmad, M. Cankaya, H. Mayer, V. Rodehorst, N. Oswald und T. Braml. „Dacl-Challenge: Semantic Segmentation During Visual Bridge Inspections“. In: Proc. IEEE/CVF Winter Conf. on Applications of Computer Vision (WACV) Workshops, 2024.

- D. Tschirschwitz, C. Benz, M. Florek, H. Noerderhus, B. Stein und V. Rodehorst. „Drawing the Same Bounding Box Twice? Coping Noisy Annotations in Object Detection with Repeated Labels“. In: Proc. German Conf. on Pattern Recognition (GCPR), 2023.

- C. Benz und V. Rodehorst. „Image-Based Detection of Structural Defects Using Hierarchical Multi-scale Attention“. In: Proc. German Conf. on Pattern Recognition (GCPR), 2022.

- D. Tschirschwitz, F. Klemstein, B. Stein und V. Rodehorst. „A Dataset for Analyzing Complex Document Layouts in the Digital Humanities and its Evaluation with Krippendorff ’s Alpha“. In: Proc. German Conf. on Pattern Recogntion (GCPR), 2022.

- C. Benz, P. Debus, H. K. Ha und V. Rodehorst. „Crack Segmentation on UAS-based Imagery using Transfer Learning“. In: Proc. Int. Conf. on Image and Vision Computing New Zealand (IVCNZ), 2019.

Label-Variationen existieren in allen Datensätzen, bleiben jedoch in solchen mit nur einer Annotation pro Bild oft verborgen. Die Reduzierung dieser Variationen ist ein direkter Weg, um die durch „Noisy Labels“ verursachten Probleme zu verringern. Zuvor muss jedoch identifiziert werden, ob es sich dabei um strukturelle Unstimmigkeiten oder lediglich um individuelle Annotationsfehler handelt.

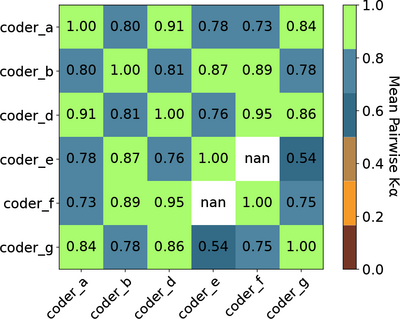

Im Rahmen des Projekts wurde das Toolkit KαLOS (KaLOS) entwickelt, um die Qualität von Datensätzen umfassend zu bewerten. Das Tool bietet detaillierte Diagnosen zur Identifizierung von:

- Schwierigen Bilder und komplexe Klassen für Annotatoren.

- Kollaborations-Cluster und unterschiedliche „Denkrichtungen“ (schools of thought).

- Annotatorenvitalität und Konsistenz einzelner Rater.

KαLOS ist sowohl für den Einsatz während der Datensatzerstellung als auch zur nachträglichen Qualitätsprüfung (post-hoc) konzipiert. Dabei ist das Tool nicht auf menschliche Annotationen beschränkt, sondern kann auch halbautomatische und vollautomatische Label-Verfahren evaluieren.

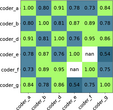

Abbildung: Kollaborations-Cluster-Analyse auf dem TexBiG-Datensatz zur Visualisierung der Übereinstimmung zwischen den Ratern. „NaN“-Werte geben an, dass diese Annotatoren keine gemeinsamen Aufgaben bearbeitet haben.

Der Quellcode von KαLOS ist auf GitHub verfügbar.

KαLOS wird im Juni 2026 als Main Track Paper auf der CVPR in Denver vorgestellt.

[1] Tschirschwitz, D., und Rodehorst, V: KαLOS finds Consensus: A Meta-Algorithm for

Evaluating Inter-Annotator Agreement in Complex Vision Tasks. IEEE/CVF Computer Vision

and Pattern Recognition Conference (CVPR), Denver, Colorado, 2026. [arXiv]