3D-Scanning und Modellprozessierung

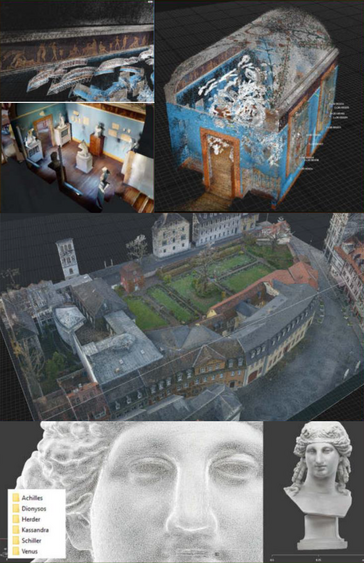

Um das Museumsangebot mit digitalen Technologien immersiv erfahrbar zu machen, ist die Erzeugung einer virtuellen Museumskopie erforderlich. Hierzu hat der Projektpartner Arctron 3D GmbH umfangreiche 3D-Digitalisierungs-Arbeiten koordiniert und realisiert. Arctron ist auf die extrem genaue und hochwertige 3D-Raum- und Objektdokumentation spezialisiert und hält sämtliche benötigte 3D-Technologien vor. Für die Digitalisierung wurden kombinierte hochwertige 3D-Scan-Technologien eingesetzt.

Erfasst wurden im Rahmen des Projekts:

- Gesamtarchitektur und Außenbereich des Goethe-Wohnhaus

- Brückenzimmer und Arbeitsvorzimmer in hoher Auflösung

- andere ausstellungsrelevante Räume im Goethe-Haus (inklusive Keller und

einigen anderen für die Öffentlichkeit nicht zugänglichen Räumen) - diverse repräsentative Exponate aus Goethes Sammlungsbestand

- historisches Miniaturmodell der Weimarer Altstadt

- "Goethe+Schiller" Statue auf dem Theaterplatz

Im weiteren Verlauf des Projektes werden diese Daten für die Applikationsentwicklung in sozialer VR eingesetzt.

Effizientes Datensteaming und Rendering

Der Projektparter Consensive GmbH arbeitet an einem Modul für das ausgabesensitive online-Streaming von hochaulösenden Daten. Dieses nutzt das quelloffene Datenformat Nexus und vereinfacht als Erweiterung des Entwicklungsframeworks Unity die plattformübergreifende Entwicklung von Anwendungen zur interaktiven Darstellung der detailreichen Modelle (siehe Abschnitt 3D-Scanning und Modellprozessierung).

Unter Verwendung des erwähnten Moduls wurden bereits Experimenten zu Schnittstellen für Desktop-computer sowie Tablets und Smartphones durchgeführt. Das Modul wird im Projektverlauf von zentraler Bedeutung bei der Auslieferung und Darstellung der virtuellen Museumskopie in allen Endbenutzeranwendungen sein.

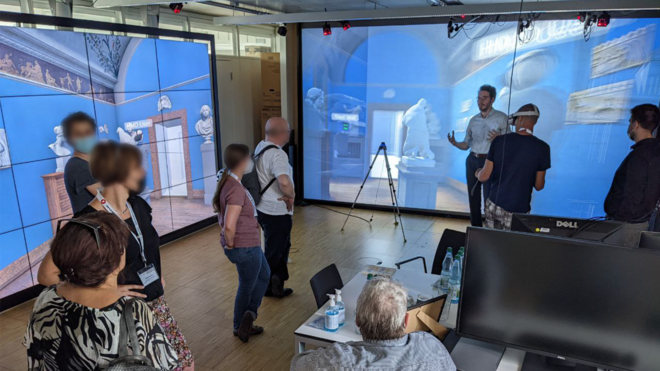

Geräteübergreifende Interaktion in Sozialer VR

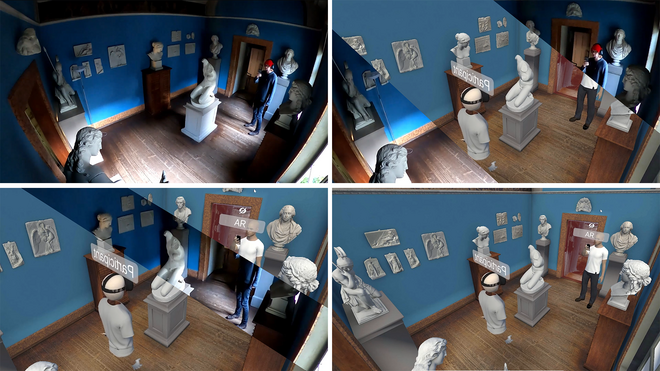

Die Virtual Reality and Visualization Research Group arbeitete im ersten Projektabschnitt an der technischen Realisierung von Grundlagentechnologie und Systemintegrationen für die kollaborative Exploration der virtuellen Museumskopie. Dazu wurden Anbindungen für Nutzer:innen von Headmounted Displays, Mehrbenutzer-Stereoprojektionssystem und Desktop-Workstations in eine gemeinsam erlebbare virtuelle Umgebung geschaffen. Im weiteren Projektverlauf wurden diese zu verschiedenen Anlässen demonstriert, um explorativ die Zugänglichkeit und Nutzbarkeit der unterschiedlichen Geräte für die kollaborative Wissensvermittlung im Rahmen des Projektkontexts zu validieren.

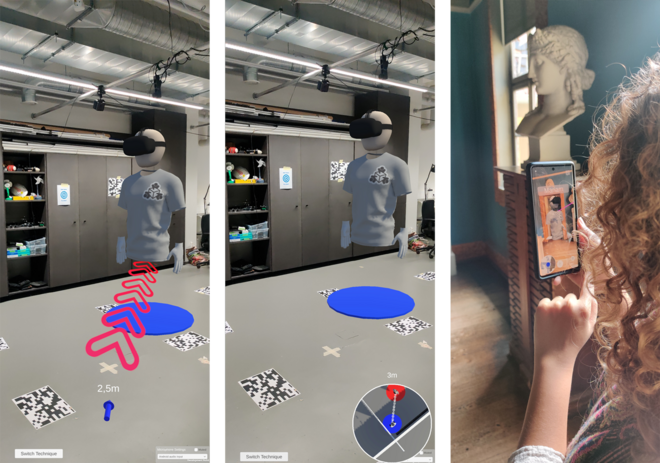

Zudem wurde ein System entwickelt und evaluiert welches Besucher:innen vor Ort den Kontakt mit einer virtuellen Begleitperson ermöglicht. Der Zugang in die virtuelle Museumskopie wurde demnach über eine AR Smartphone Integration realisiert. Die Diskrepanz zwischen Interaktionsmöglichkeiten lokaler und entfernter Besucher:innen in einem gemeinsamen sozialen Kontext, stellt für die Virtual Reality and Visualization Group einen besonderen Forschungsschwerpunkt dar. In diesem Zusammenhang wurden in der Gruppe zwei Techniken entwickelt und evaluiert, welche Besucher:innen im Museum dabei unterstützen ihre virtuelle Begleitung zuverlässig und schnell zu lokalisieren und ihr zu folgen.

Die Verkörperung der Smartphone-Nutzer:innen wurden durch einen Avatar mit inverser Kinematik (IK) realisiert. Mithilfe entsprechender Tastenbedienung auf dem Smartphone erhielten Besucher:innen vor Ort zusätzliche Funktionalität zur Verwendung natürlicher Gesten wie Zeigen und Winken. Bei einer Expertenbefragung im Goethe Nationalmuseum und dem digitalen Zwilling wurde sowohl für den VR- als auch für den Smartphone-AR-Nutzenden vor Ort eine insgesamt hohe soziale Präsenz beobachtet. Dies bestätigt, dass die Awareness-Visualisierungen und die Verkörperung des Smartphone-Nutzers als IK-Avatar gut funktionierten und dass Besucher:innen vor Ort und aus der Ferne erfolgreich miteinander kommunizieren konnten.

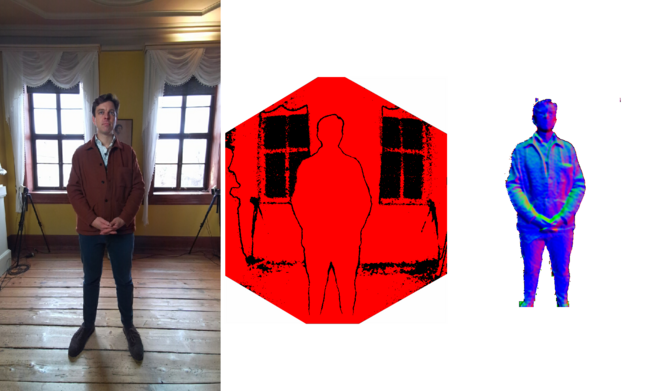

Echtzeitrekonstruktion Volumetrischer Avatare

Volumetrische Echtzeitrekonstrukionen von Museumsführer:innen auf Basis konvenioneller Farb- und Tiefenkameras ermöglichen es Teilnehmer:innen virtueller Führungen einen von allen Betrachtungswinkeln realistischen visuellen Eindruck ihres Gegenübers zu erlangen. Dies ist insbesondere dann wünschenswert, wenn das virtuelle Erscheinungsbild der führenden Person thematisch im Kontext des Museums stehen soll und eine generische, abstrakte Repräsentation den visuellen Informationskanal potenziell einschränkt.

Den Kern volumetrischer Avatar-Rekonstruktion bildet die volumetrischen Integration von Farb- und Tiefenbeiträgen, sowie daraus abgeleiteter Attribute. Kommerziell verfügbare RGBD-Sensoren sind in der Lage solche Farb- und Tiefenbeiträge mit einer aus der Videotechnik gewohnten Aufnahmeraten zur Verfügung zu stellen. Zeitlich synchronisierte Beiträge mehrerer dieser räumlich aufeinander registrierten Sensoren werden gefiltert und anschließend in eine volumetrische Datenstruktur integriert, um verrauschte Beiträge der Sensoren zu glätten und ein einziges konsistentes und texturiertes Oberflächenmodell zu generieren.

Um den an der Virtual Reality and Visualization Group entstandenen Prototypen zu testen und die Anwendbarkeit der entwickelten Technologie auch außerhalb einer kontrollierten Laborumgebung zu validieren, wurden mehrere exemplarische Aufnahmen eines Kustoden der Klassik Stiftung Weimar in Form volumetrischer Avatar-Repräsentationen sowie synchronisierter Audioaufnahmen innerhalb des Gelben Saals des Goethe Nationalmuseums erhoben. Die Interaktion mit diesen realistischen Avatar-Aufzeichnungen in repräsentativen Anwendungenszenarien der kollaborativen virtuellen Realität wird ein zentraler Fokus im Fortlauf des Verbundprojekts sein.

Virtuelle Museumsguides

Zu Projektbeginn wurden durch die Universität Hamburg die konkreten Anforderungen der Klassik Stiftung Weimar an virtuelle Agenten als Museumsguides evaluiert. Dabei standen die unterschiedlichen Bedürfnisse verschiedener identifizierter Besuchergruppen sowie die historische Akkuratheit der entwickelten Abbilder historischer Persönlichkeiten im Vordergrund. Drei verschiedene Modelltypen (manuell modelliert, realistisch aus Gemälde generiert, stilisiert aus Gemälde generiert) wurden in diesem Zusammenhang betrachtet.

Zudem steht auch die Glaubwürdigkeit im Verhalten virtueller Agenten im Abgleich mit den aus dem Feedback isolierten Anforderungen. Der VR/AR-Community wurde auf der Konferenz ACM CHI in diesem Zusammenhang eine Publikation vorgestellt:

Erreichte Einblicke tragen maßgeblich zur inkrementellen Entwicklung zukünftiger Arbeiten und Anwendungen im Projekt bei.

Redirected Walking

Die Erkundung von virtuellen Räumen mithilfe von Virtual-Reality-Technologien ist hinsichtlich der unterschiedlichen Größen des physischen und virtuellen Raumes nicht immer reibungslos zu ermöglichen. Curvature Games entwickelt Redirected-Walking-Techniken, die es mehreren lokalen Benutzer:innen ermöglichen, mit kabellosen Headmounted-Displays kooperativ im Raum zu interagieren und zu navigieren ohne die Begrenzungen des realen Raums wahrzunehmen.

Im Projekt wurden von Curvature Anwendungen dessen entwickelt um in der Lage zu sein mit einem 3,5 x 3,5m Playspace, Teile des gelben Saals und das gesamte Brückenzimmer an einem Stück durch physisches Laufen erkunden zu können. Im Verlauf des Projektes wird geprüft ob die Anwendung von Redirected Walking effektiv auf das gesamte Museum ausgeweitet werden kann.