mNo edit summary |

|||

| (6 intermediate revisions by 2 users not shown) | |||

| Line 1: | Line 1: | ||

== Motivation == | == Motivation == | ||

Inwiefern lässt sich das Körpergefühl eines Menschen beeinflussen, indem seine Bewegungen mit Klängen kombiniert werden? | Inwiefern lässt sich das Körpergefühl eines Menschen beeinflussen, indem seine Bewegungen mit Klängen kombiniert werden? | ||

Diese Frage ist ohne Weiteres nicht zu beantworten. Mithilfe von OSCeleton, | Diese Frage ist ohne Weiteres nicht zu beantworten. Mithilfe von OSCeleton, Pure Data und SimpleSynth näherten wir uns dem Thema an. | ||

== | == Umsetzung == | ||

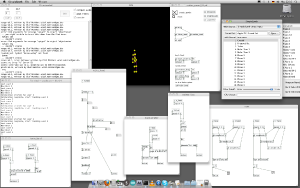

[[File:pk-2011-EarMOTION-code.jpg|thumb|Screenshot bei der Arbeit]] | |||

Zahlen, Bewegungen und akustische Signale unter einen Hut zu bringen bedarf einiger Vorbereitung. Nur durch ständiges Experimentieren, Verwerfen, Umstrukturieren und Andersmaches sind wir mit dem Projekt voran gekommen. Entstanden ist ein audiovisuelles Tool, dass sich mehr oder weniger intuitiv steuern lässt - pathetischerweise heißt es fortan "EarMOTION". Es bleibt nach wie vor ein experimenteller Ansatz zur Annäherung an die eingangs gestellte Frage und erhebt keinen Anspruch auf ein vollständiges Konzept. | |||

<br clear="all" /> | |||

== Funktion == | |||

Das Tool ist in einzelne Bewegungseinheiten gegliedert. | |||

Wird der Kopf geneigt, ertönt ein sphärischer Sound. Mit einer Hand wird ein Instrument dirigiert, während die Andere hauptsächlich als Schalter dient. Mit ihr kann die Lautstärke geändert oder aber ein anderes Instrument ausgewählt werden. Der Bewegung der Füße sind Percussionelemente zugeordnet. Geht man aber in die Knie wird der Ton gebeugt. | |||

Weitere Ideen werden momentan auf ihre Konzepttauglichkeit geprüft. Andere haben wir verworfen und für einige war die Zeit leider zu knapp. | |||

<videoflash type=vimeo>33558678|530|300</videoflash> | |||

Latest revision as of 15:44, 21 December 2011

Motivation

Inwiefern lässt sich das Körpergefühl eines Menschen beeinflussen, indem seine Bewegungen mit Klängen kombiniert werden? Diese Frage ist ohne Weiteres nicht zu beantworten. Mithilfe von OSCeleton, Pure Data und SimpleSynth näherten wir uns dem Thema an.

Umsetzung

Zahlen, Bewegungen und akustische Signale unter einen Hut zu bringen bedarf einiger Vorbereitung. Nur durch ständiges Experimentieren, Verwerfen, Umstrukturieren und Andersmaches sind wir mit dem Projekt voran gekommen. Entstanden ist ein audiovisuelles Tool, dass sich mehr oder weniger intuitiv steuern lässt - pathetischerweise heißt es fortan "EarMOTION". Es bleibt nach wie vor ein experimenteller Ansatz zur Annäherung an die eingangs gestellte Frage und erhebt keinen Anspruch auf ein vollständiges Konzept.

Funktion

Das Tool ist in einzelne Bewegungseinheiten gegliedert.

Wird der Kopf geneigt, ertönt ein sphärischer Sound. Mit einer Hand wird ein Instrument dirigiert, während die Andere hauptsächlich als Schalter dient. Mit ihr kann die Lautstärke geändert oder aber ein anderes Instrument ausgewählt werden. Der Bewegung der Füße sind Percussionelemente zugeordnet. Geht man aber in die Knie wird der Ton gebeugt. Weitere Ideen werden momentan auf ihre Konzepttauglichkeit geprüft. Andere haben wir verworfen und für einige war die Zeit leider zu knapp. <videoflash type=vimeo>33558678|530|300</videoflash>